根据TrendForce最新报告显示,AI需求激增使得AI服务器客户在过去两个季度内大幅增加了企业级SSD的订单。上游供应商也加速了工艺升级,计划在2025年量产采用200层以上NAND的SSD产品,以应对AI应用中对SSD日益增长的需求。

报告指出,由于AI服务器客户增加了企业级SSD的订单,导致这一类别的合同价格从2023年第四季度到2024年第三季度上涨了超过80%。SSD在AI开发中扮演着至关重要的角色。在AI模型训练中,SSD主要用于存储模型参数,包括不断变化的权重和偏差。

另一个关键应用是创建检查点,以便定期保存AI模型训练进度,如果训练中断,可以从特定点恢复。因此,客户通常选择4TB/8TB的TLC SSD,以满足训练过程中对快速数据传输和高写入耐久性的要求。

TrendForce还指出SSD在AI推理服务器中帮助调整和优化AI模型,在推理过程中可以实时更新数据,以微调模型的输出。AI推理主要提供检索增强生成(RAG)和大语言模型(LLM)服务。SSD存储RAG和LLM用于生成信息的参考文件和知识库。

此外,随着越来越多的信息以视频或图像形式生成,所需的存储容量也在增加,使得TLC/QLC 16TB或更大的高容量SSD成为AI推理应用的首选。

2024年,AI服务器SSD市场在第二季度开始对16TB以上的大容量产品需求显著增加。随着英伟达H100、H20和H200系列产品的到来,客户进一步增加了4TB和8TB TLC企业级SSD的订单。

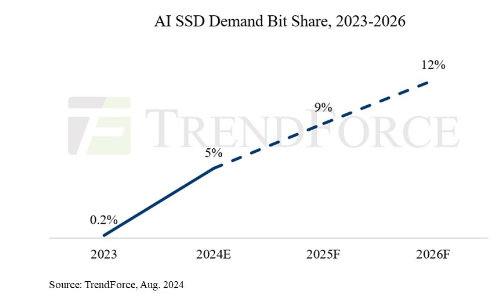

TrendForce估计,今年AI相关的SSD采购量将超过45 EB。未来几年,AI服务器预计将推动SSD求60%,AI SSD需求占总NAND Flash消费量的比例可能从2024年的5%上升到2025年的9%。

AI推理服务器将继续采用高容量SSD产品。供应商已经开始加速工艺升级,计划从2025年第一季度开始量产200,甚至300层产品,最终推出120TB以上的企业级SSD产品。